Hi,

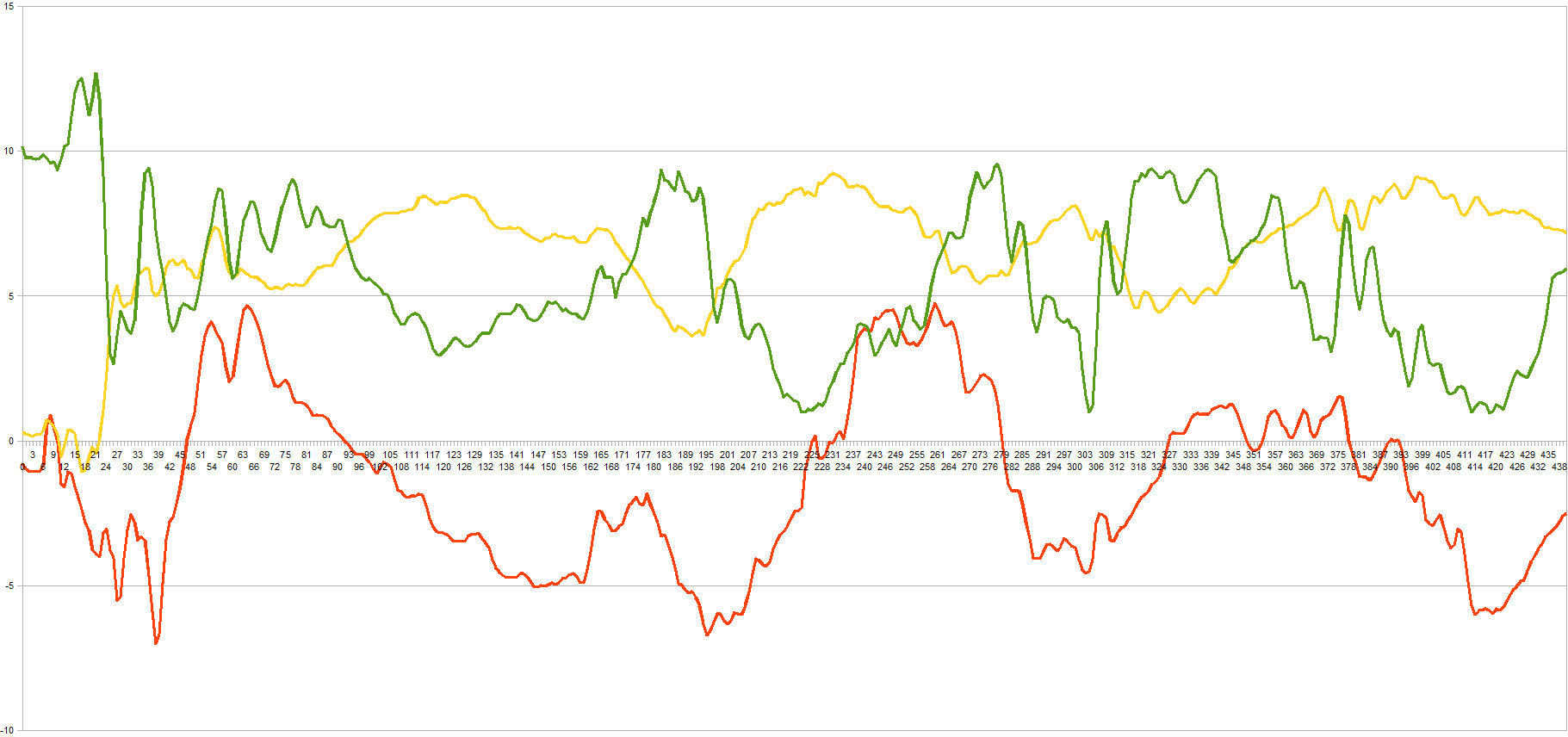

ich schreibe derzeit an nem App für mein Handy bei dem ich eine "Time between Peaks" Detection brauche. Nun habe ich eine ganze Menge Werte ( in 10 Sekunden ~ 400Werte ) welche eigentlich ausreichen um die extremstellen zu "berechnen".

Es geht im Grunde um Bewegungssensordaten.

Ich möchte so wenig rechenaufwand wie möglich, da ich bereits dinge wie standardabweichung etc berechne und ich ich nicht will, dass die berechnung sehr stört.

Allerdings finde ich keinen fertigen code im internet der dies ermöglicht und habe auch selbst keine idee dazu.

Habt ihr schon einmal an so etwas gearbeitet oder habt ideen, wie ich an die sache herangehen sollte?

Ich habe die graphen mal in openoffice calc geplotted. Damit ihr euch das auch ein bisschen bildlich vorstellen könnt.

ich schreibe derzeit an nem App für mein Handy bei dem ich eine "Time between Peaks" Detection brauche. Nun habe ich eine ganze Menge Werte ( in 10 Sekunden ~ 400Werte ) welche eigentlich ausreichen um die extremstellen zu "berechnen".

Es geht im Grunde um Bewegungssensordaten.

Ich möchte so wenig rechenaufwand wie möglich, da ich bereits dinge wie standardabweichung etc berechne und ich ich nicht will, dass die berechnung sehr stört.

Allerdings finde ich keinen fertigen code im internet der dies ermöglicht und habe auch selbst keine idee dazu.

Habt ihr schon einmal an so etwas gearbeitet oder habt ideen, wie ich an die sache herangehen sollte?

Ich habe die graphen mal in openoffice calc geplotted. Damit ihr euch das auch ein bisschen bildlich vorstellen könnt.

Zuletzt bearbeitet: